Was ist das Subgradienten-Verfahren?

Das Subgradienten-Verfahren ist eine Methode der Optimierung, speziell entwickelt, um mit nicht differenzierbaren Funktionen umzugehen. Insbesondere findet es Anwendung in der Optimierung konvexer Funktionen, wo herkömmliche Gradientenmethoden aufgrund der fehlenden Differenzierbarkeit an ihre Grenzen stoßen. Durch die Nutzung von Subgradienten, die eine Verallgemeinerung der herkömmlichen Gradienten darstellen, ermöglicht dieses Verfahren die Suche nach einem Minimum oder Maximum selbst dann, wenn die üblichen Voraussetzungen für die Anwendung eines Gradientenverfahrens nicht erfüllt sind.

Subgradienten-Verfahren Definition

Ein Subgradient einer konvexen Funktion bei einem gegebenen Punkt ist ein Vektor, der nicht unbedingt eindeutig ist, und der die Funktion in diesem Punkt von unten her tangiert. Das Subgradienten-Verfahren ist eine Optimierungstechnik, die Subgradienten verwendet, um in iterativen Schritten ein Optimum einer konvexen Funktion zu finden, auch wenn diese Funktion nicht differenzierbar ist.

Grundprinzipien des Subgradienten-Verfahrens

Das Grundprinzip des Subgradienten-Verfahrens basiert auf der schrittweisen Annäherung an ein Optimum durch die Nutzung von Subgradienten anstelle der gewöhnlichen Gradienten. Hier sind die Kernpunkte, die das Verfahren definieren:

- Wahl des Startpunkts: Die Methode beginnt mit der Wahl eines beliebigen Startpunkts im Definitionsbereich der Zielfunktion.

- Berechnung des Subgradienten: Bei jedem Iterationsschritt wird ein Subgradient der Funktion am aktuellen Punkt berechnet.

- Update des aktuellen Punkts: Mithilfe des berechneten Subgradienten wird der aktuelle Punkt aktualisiert, um sich dem Optimum anzunähern. Dies geschieht typischerweise durch die Subtraktion eines Produkts aus dem Subgradienten und einer Schrittweite vom aktuellen Punkt.

- Schrittweitensteuerung: Die Wahl der Schrittweite ist entscheidend für das Verfahren und kann nach verschiedenen Strategien festgelegt werden, um Konvergenz zu gewährleisten.

Da das Subgradienten-Verfahren auch bei nicht-differenzierbaren Funktionen anwendbar ist, ist es ein wertvolles Werkzeug bei vielen praktischen Problemen in der Optimierung, insbesondere bei der Lösung von Minimierungsproblemen in der maschinellen Lerntheorie und der Netzwerkoptimierung.

Anwendungsbereiche des Subgradienten-Verfahrens

Das Subgradienten-Verfahren findet seine Anwendung in verschiedenen Bereichen, die von der Optimierung von Produktionsprozessen bis hin zur Datenanalyse und maschinellem Lernen reichen. Diese Vielseitigkeit verdankt es seiner Fähigkeit, mit nicht-differenzierbaren oder schwer zu differenzierenden Funktionen umzugehen, was in der realen Welt häufig vorkommt.Insbesondere bei der Optimierung von konvexen Funktionen, deren exakte Minima oder Maxima schwer zu bestimmen sind, bietet das Subgradienten-Verfahren eine effektive Lösung. Durch die iterative Annäherung an das Optimum unter Verwendung von Subgradienten, hebt sich das Verfahren von klassischen Methoden ab, die auf differenzierbare Funktionen angewiesen sind.

Subgradienten-Verfahren Anwendung in der Praxis

In der Praxis wird das Subgradienten-Verfahren in vielen Fachgebieten angewendet. Einige der herausragenden Beispiele umfassen die Netzwerkoptimierung, in der das Verfahren zur Planung von optimalen Routen in komplexen Netzwerken eingesetzt wird, und im Bereich des maschinellen Lernens, speziell bei Support-Vektor-Maschinen, wo es zur Maximierung der Margen zwischen den klassifizierenden Hyperebenen und den Datenpunkten verwendet wird.Weitere Anwendungen finden sich in der Operationsforschung und industriellen Optimierung, wo z.B. Produktionsprozesse unter Berücksichtigung verschiedener Restriktionen und Zielsetzungen optimiert werden müssen. Das Subgradienten-Verfahren bietet hier eine robuste Methode, um Lösungen zu approximieren, die mit herkömmlichen Verfahren schwer zu erreichen sind.

Optimierung mit Subgradienten-Verfahren in verschiedenen Feldern

Das Subgradienten-Verfahren findet breite Anwendung über eine Vielzahl von Disziplinen hinweg:

- Operationsforschung: Optimierung von Transportwegen und -kosten in Logistiknetzwerken.

- Computervision: Anwendung in der Bildsegmentierung und bei der Objekterkennung, oftmals im Kontext von maschinellem Lernen.

- Finanzmathematik: Optimierung von Investmentportfolios unter Unsicherheit, basierend auf nicht-differenzierbaren Risikomaßen.

- Energieversorgungs-Management: Optimierung des Betriebs von Stromnetzen und der Planung von Energieerzeugungskapazitäten.

- Telekommunikation: Optimale Allokation von Ressourcen innerhalb von Netzwerken zur Maximierung der Datenübertragungseffizienz oder zur Minimierung von Verzögerungen.

Eine interessante Beobachtung ist, dass das Subgradienten-Verfahren insbesondere in Szenarien seine Stärken ausspielt, wo Daten nur unvollständig oder unsicher sind, was in vielen realen Anwendungsfällen der Fall ist.

Praktische Beispiele zum Subgradienten-Verfahren

Das Subgradienten-Verfahren ist eine leistungsstarke Technik in der Optimierung, die besonders nützlich ist, wenn man mit nicht differenzierbaren oder schwer differenzierbaren Funktionen konfrontiert wird. Dies macht es zu einem unverzichtbaren Werkzeug in vielen Anwendungsbereichen. In diesem Abschnitt werden wir uns einige praktische Beispiele ansehen, wie das Subgradienten-Verfahren im Alltag und in spezifischen Branchen erfolgreich eingesetzt wird.Obwohl das Konzept zunächst abstrakt erscheinen mag, sind seine Anwendungen weitreichend und berühren viele Aspekte unseres täglichen Lebens sowie komplexe industrielle Prozesse.

Subgradienten-Verfahren Beispiel aus dem Alltag

Ein alltägliches Beispiel für die Anwendung des Subgradienten-Verfahrens ist die Planung des kürzesten Weges in einem Netzwerk, wie z.B. das Finden der schnellsten Route mit einem Navigationsgerät. Dabei werden viele Variablen betrachtet, wie Straßenzustände und Verkehr, die die Reisezeit beeinflussen können. Diese Bedingungen kreieren ein Optimierungsproblem, das sich hervorragend mit dem Subgradienten-Verfahren angehen lässt.

| Gegeben: Ein Netzwerk von Straßen | Gesucht: Die schnellste Route von A nach B |

| Problem: Nicht-differenzierbare Variablen (Verkehr) | Lösung: Subgradienten-Verfahren |

Case Studies: Erfolgsgeschichten mit dem Subgradienten-Verfahren

Ein herausragendes Beispiel für die Anwendung des Subgradienten-Verfahrens in der Industrie ist das Management von Lieferketten großer Unternehmen. Durch die Optimierung der Routen, Lagerbestände und Lieferzeiten können Unternehmen signifikante Einsparungen erzielen und ihre Effizienz steigern.Ein konkretes Beispiel ist ein globales Einzelhandelsunternehmen, das sein Warenverteilungsnetz optimierte, um Lieferzeiten zu verkürzen und den Kraftstoffverbrauch zu reduzieren. Hierbei half das Subgradienten-Verfahren, ein komplexes, nicht-differenzierbares Optimierungsproblem zu lösen, das aus der enormen Anzahl möglicher Routen zwischen Lieferzentren und Geschäften resultierte. Die Optimierung führte zu einer erheblichen Kosteneinsparung und einer höheren Kundenzufriedenheit durch schnellere Lieferzeiten.

Obwohl das Subgradienten-Verfahren in der theoretischen Mathematik verwurzelt ist, sind seine praktischen Anwendungen unglaublich vielschichtig und können im Alltag oft unbemerkt bleiben.

Ein weiteres beeindruckendes Beispiel für die Anwendung des Subgradienten-Verfahrens findet sich im Energiehandel, wo Unternehmen stündliche Preise für Strom in dynamischen Märkten optimieren. Aufgrund der hohen Volatilität von Energiepreisen und Nachfrageschwankungen stellt dies ein hochkomplexes Optimierungsproblem dar. Das Subgradienten-Verfahren ermöglicht es, optimale Entscheidungen in nahezu Echtzeit zu treffen, indem es eine Vielzahl von Faktoren berücksichtigt, einschließlich erneuerbarer Energiequellen, Verbrauchernachfrage und Netzwerkkapazitäten, um die Profitabilität zu maximieren und die Stabilität des Netzes zu gewährleisten.

Das Subgradienten-Verfahren einfach erklärt

Das Subgradienten-Verfahren ist eine Optimierungstechnik, die besonders dann zum Einsatz kommt, wenn man mit nicht-differenzierbaren oder nur schwer differenzierbaren Funktionen konfrontiert ist. Stell Dir vor, Du hast eine Landschaft mit H{"u}geln und T{"a}lern (diese stellen die Zielfunktion dar) und möchtest den tiefsten Punkt finden, ohne dabei über jeden einzelnen H{"u}gel klettern zu m{"u}ssen. Das Subgradienten-Verfahren hilft dir, diesen tiefsten Punkt effizient zu finden, auch wenn der direkte Weg dorthin nicht offensichtlich ist.Im Kern des Verfahrens steht die Nutzung von Subgradienten. Ein Subgradient verh{"a}lt sich {"a}hnlich wie ein Gradient bei differenzierbaren Funktionen, aber er ist auch für nicht-differenzierbare Funktionen definiert. Dies macht das Verfahren so vielseitig und n{"u}tzlich bei der L{"o}sung realer Optimierungsprobleme.

Subgradienten-Verfahren einfach erklärt mit Grafiken

Um das Subgradienten-Verfahren besser zu verstehen, stellen wir uns eine einfache grafische Darstellung vor. Angenommen, Du hast eine flache Oberfl{"a}che, die an bestimmten Punkten mit steilen Klippen unterbrochen ist (diese Klippen stellen nicht-differenzierbare Punkte dar).Eine konvexe Funktion auf dieser Oberfl{"a}che k{"o}nnte wie ein Berg aussehen, und unser Ziel ist es, den niedrigsten Punkt zu erreichen. Ein Subgradient zeigt an jedem Punkt der Funktion in irgendeine Richtung, die steil genug ist, dass, wenn du ihr folgst, du dich dem tiefsten Punkt n{"a}hern w{"u}rdest. Dies erm{"o}glicht es uns, auch bei schwierig navigierbaren Funktionen nach und nach zum Minimum zu gelangen.

Subgradienten-Verfahren Übungsaufgaben zum Selbstlernen

Um das Subgradienten-Verfahren besser zu verstehen, ist es hilfreich, ein paar Übungsaufgaben selbst zu l{"o}sen. Übung 1: Betrachte die Funktion \(f(x) = |x|\), die bei \(x = 0\) nicht differenzierbar ist. Deine Aufgabe ist es, mithilfe des Subgradienten-Verfahrens das Minimum der Funktion zu finden. Übung 2: Gegeben sei die Funktion \(f(x) = \max(2x, 3x-4)\). Finde das Minimum der Funktion mit dem Subgradienten-Verfahren. Beachte, dass die Funktion an dem Punkt, an dem \(2x\) gleich \(3x-4\) ist, einen Knick hat und somit nicht differenzierbar ist.Diese Aufgaben helfen Dir, ein Gef{"u}hl daf{"u}r zu bekommen, wie das Subgradienten-Verfahren funktioniert und wie man es anwendet, selbst wenn die Funktionen an bestimmten Punkten nicht differenzierbar sind.

Denke bei der Anwendung des Subgradienten-Verfahrens auf die Übungsaufgaben daran, dass ein Subgradient nicht eindeutig sein muss. Es kann mehrere Subgradienten an einem Punkt geben, die alle in unterschiedliche Richtungen zeigen k{"o}nnen.

Subgradienten-Verfahren - Das Wichtigste

- Das Subgradienten-Verfahren ist eine Methode der Optimierung f{"u}r nicht differenzierbare oder schwer zu differenzierbare konvexe Funktionen.

- Definition: Ein Subgradient ist ein Vektor, der eine konvexe Funktion an einem Punkt von unten tangiert und dort die Funktion unterst{"u}tzt.

- Anwendung: Optimierung von Produktionsprozessen, Datenanalyse, maschinelles Lernen und Netzwerkoptimierung.

- Beispiel: Routenplanung unter Verwendung von Subgradienten, um die schnellste Strecke unter Ber{"u}cksichtigung von dynamischen Bedingungen wie Verkehr zu berechnen.

- Vorgehensweise: Iterative Ann{"a}herung an das Optimum durch Aktualisierung des aktuellen Punkts mithilfe des berechneten Subgradienten und einer geeigneten Schrittweite.

- {"U}bungsaufgaben: Anwendung des Subgradienten-Verfahrens auf spezifische nicht differenzierbare Funktionen zur Festigung des Verst{"a}ndnisses.

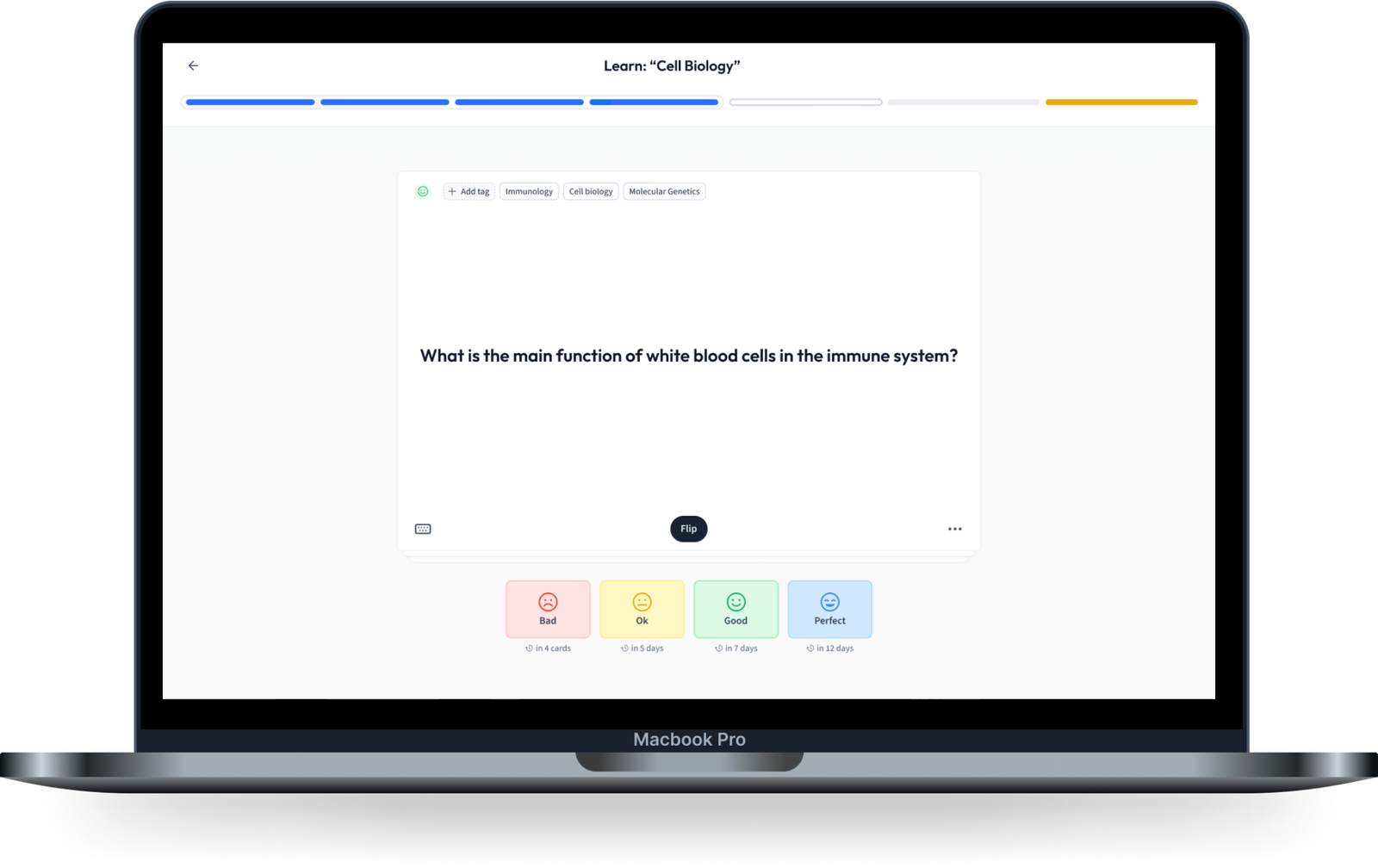

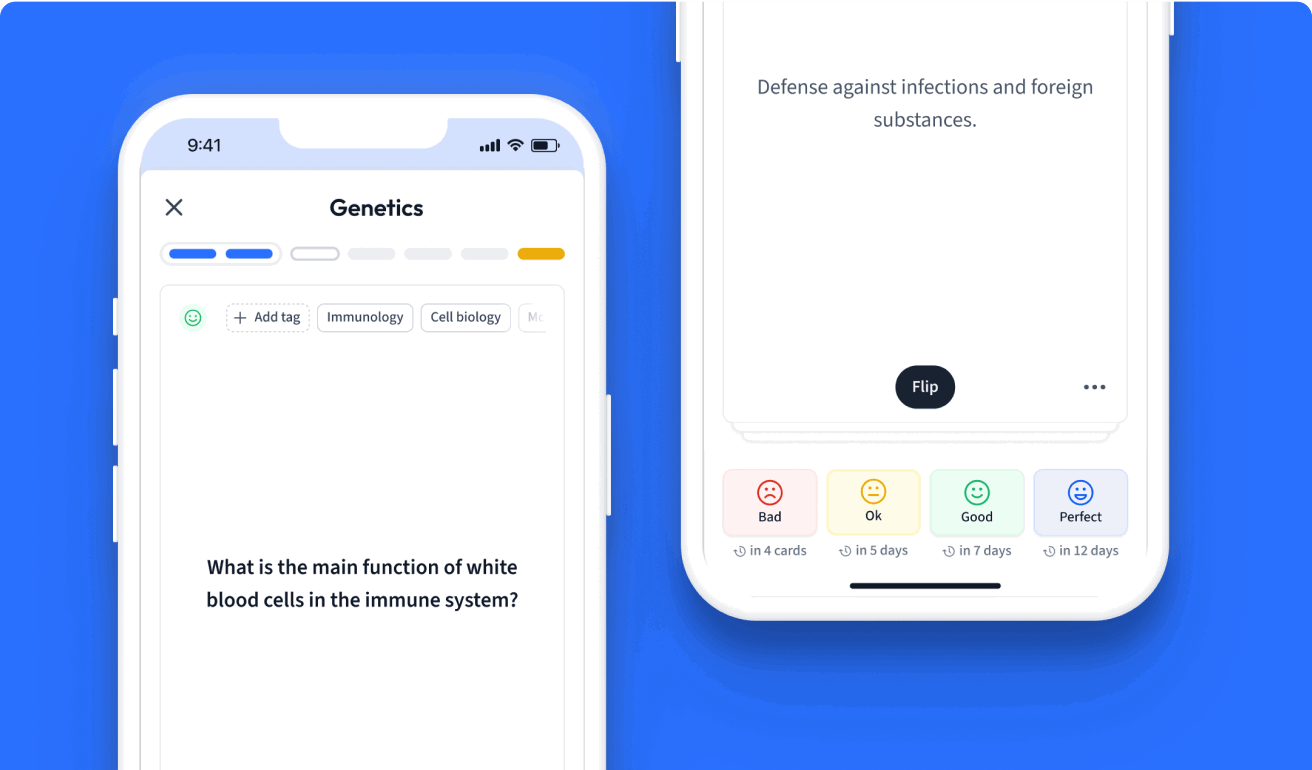

Lerne mit 0 Subgradienten-Verfahren Karteikarten in der kostenlosen StudySmarter App

Wir haben 14,000 Karteikarten über dynamische Landschaften.

Du hast bereits ein Konto? Anmelden

Häufig gestellte Fragen zum Thema Subgradienten-Verfahren

Über StudySmarter

StudySmarter ist ein weltweit anerkanntes Bildungstechnologie-Unternehmen, das eine ganzheitliche Lernplattform für Schüler und Studenten aller Altersstufen und Bildungsniveaus bietet. Unsere Plattform unterstützt das Lernen in einer breiten Palette von Fächern, einschließlich MINT, Sozialwissenschaften und Sprachen, und hilft den Schülern auch, weltweit verschiedene Tests und Prüfungen wie GCSE, A Level, SAT, ACT, Abitur und mehr erfolgreich zu meistern. Wir bieten eine umfangreiche Bibliothek von Lernmaterialien, einschließlich interaktiver Karteikarten, umfassender Lehrbuchlösungen und detaillierter Erklärungen. Die fortschrittliche Technologie und Werkzeuge, die wir zur Verfügung stellen, helfen Schülern, ihre eigenen Lernmaterialien zu erstellen. Die Inhalte von StudySmarter sind nicht nur von Experten geprüft, sondern werden auch regelmäßig aktualisiert, um Genauigkeit und Relevanz zu gewährleisten.

Erfahre mehr